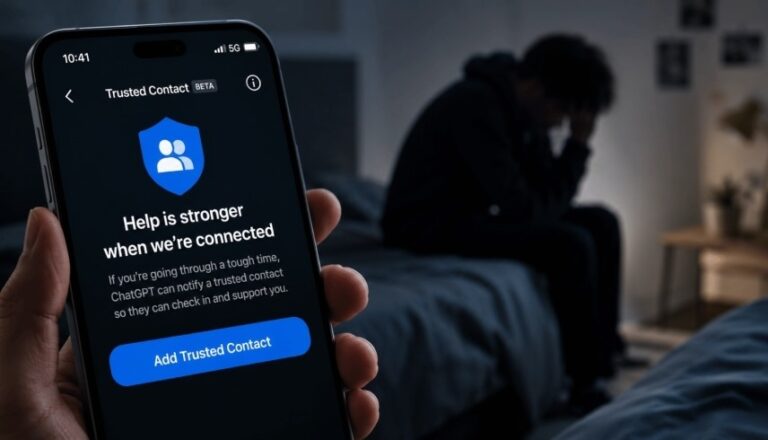

أتاحت شركة OpenAI ميزة جديدة في روبوت الدردشة “شات جي بي تي” تحمل اسم “Trusted Contact”، تتيح للمستخدمين تعيين شخص موثوق يمكن التواصل معه في حال رصد مؤشرات على خطر إيذاء النفس أو الانتحار، في خطوة تهدف إلى تعزيز أدوات السلامة الرقمية والدعم النفسي داخل المنصة.

وتعتمد ميزة “Trusted Contact” على تطوير أدوات الرقابة الأبوية الحالية، حيث تتيح للمستخدمين البالغين من العمر 18 عاماً فأكثر إضافة شخص بالغ واحد ضمن إعدادات التطبيق كجهة اتصال موثوقة. ويتعين على هذا الشخص قبول الدعوة خلال أسبوع، وإلا يمكن للمستخدم اختيار جهة اتصال أخرى.

وبحسب الشركة، سيقوم النظام أولاً بتحذير المستخدم من إمكانية التواصل مع الشخص الموثوق إذا تم رصد خطر جدي لإيذاء النفس، مع تشجيعه على التواصل بنفسه مع صديقه أو المقرب منه، واقتراح عبارات يمكن استخدامها لبدء الحوار.

وأكدت OpenAI أن العملية لن تكون آلية بالكامل، إذ ستتولى مجموعة صغيرة من الأشخاص المدربين خصيصاً مراجعة الحالات قبل إرسال أي تنبيه، ولن يتم التواصل مع الشخص الموثوق إلا إذا تأكد وجود خطر حقيقي.

وسيصل التنبيه إلى جهة الاتصال عبر البريد الإلكتروني أو الرسائل النصية أو إشعار داخل التطبيق، متضمناً رسالة تفيد بأن المستخدم “قد يمر بوقت صعب”، مع دعوة الشخص الموثوق للاطمئنان عليه.

كما سيتم إبلاغه بأن الشركة رصدت محادثة تتعلق بأفكار انتحارية، دون مشاركة نصوص المحادثات حفاظاً على خصوصية المستخدمين.

وأوضحت الشركة أن جميع التنبيهات تخضع لمراجعة بشرية مدربة قبل إرسالها، مشيرة إلى أنها تسعى إلى مراجعة هذه الحالات خلال أقل من ساعة، مع الإقرار بأن النظام ليس مثالياً وقد لا يعكس دائماً الحالة النفسية الدقيقة للمستخدم.

وتأتي الخطوة مع تزايد اعتماد المستخدمين على “شات جي بي تي” كوسيلة للدعم النفسي والعاطفي، بعدما كشفت الشركة سابقاً لهيئة الإذاعة البريطانية BBC أن أكثر من مليون مستخدم من أصل 800 مليون مستخدم أسبوعي يعبّرون عن أفكار انتحارية خلال محادثاتهم مع الروبوت الذكي.

وكانت الشركة قد واجهت العام الماضي دعوى قضائية تتعلق بالقتل الخطأ، اتهمتها بالمساهمة في انتحار مراهق، بعدما تحدث مع “شات جي بي تي” عن أربع محاولات سابقة لإنهاء حياته، قبل أن يساعده النظام – وفقاً للدعوى – في التخطيط لعملية الانتحار.

كما كشف تحقيق أجرته BBC في نوفمبر (تشرين الثاني) 2025 أن “شات جي بي تي” قدّم في إحدى الحالات نصائح لمستخدمة حول كيفية الانتحار، وهو ما دفع الشركة إلى التأكيد لاحقاً أنها حسّنت آليات استجابة النظام للأشخاص الذين يمرون بحالات نفسية حرجة.